În discuțiile mele cu managementul din diverse organizații și companii din ultimul an, am observat un tipar care se repetă. Toți cei care folosesc, integrează sau dezvoltă sisteme de inteligență artificială au auzit de AI Act. Cu toate acestea, puțini au citit textul regulamentului european și, mai puțini, au un răspuns clar la o întrebare esențială.

În opinia mea, aceasta este întrebarea care contează cu adevărat: cum demonstrează, în fața unui auditor, a unei autorități de supraveghere, a unui client corporativ sofisticat sau a propriilor angajați, că inteligența artificială pe care o operează este sub control? Aici începe, în mod real, discuția despre certificare AI Act.

Articolul acesta se adresează direct acestei categorii. El îi vizează pe cei care folosesc sau integrează sisteme AI cu impact semnificativ și care vor să producă dovezi concrete de guvernanță și conformitate, pe un calendar propriu și la momentul potrivit pentru organizația lor.

Mesajul nu se referă la companiile de tehnologie care vând modele de IA. El vizează organizațiile care le aplică în recrutare, în evaluarea riscului de credit, în diagnosticare medicală sau în educație. De asemenea, se aplică celor care folosesc AI în controlul accesului biometric, în analiza comportamentală sau în oricare dintre domeniile listate în Anexa III a Regulamentului.

Pentru aceste organizații, instrumentul cel mai bun disponibil astăzi pentru construirea și demonstrarea acestei guvernanțe este standardul SR ISO/IEC 42001:2024. Certificarea pe acest standard este, în opinia mea, investiția cu cel mai bun raport efort-rezultat pe care o poate face o conducere preocupată de modul în care folosește AI.

SR ISO/IEC 42001:2024 – Un standard care vine la momentul potrivit

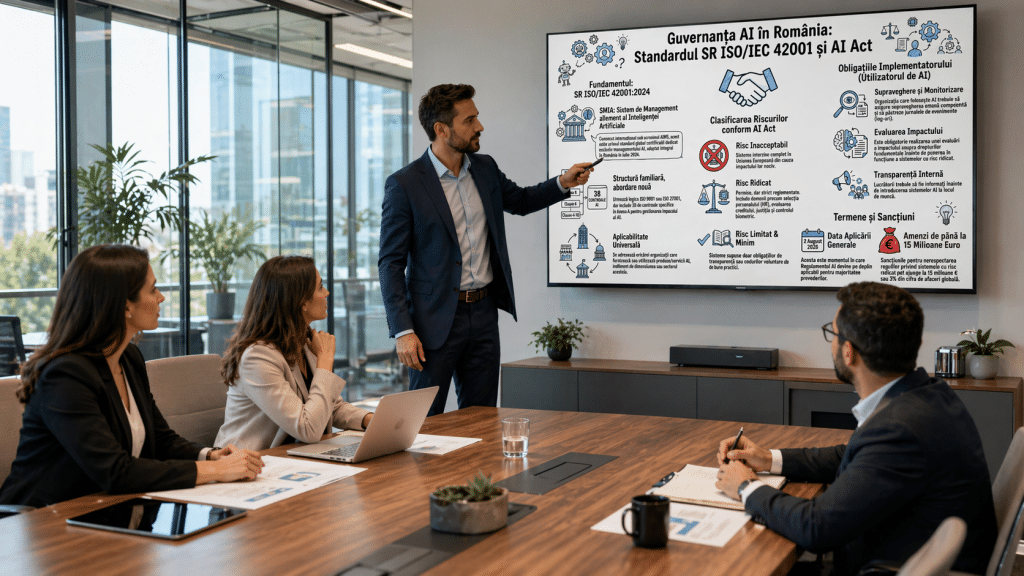

Standardul internațional ISO/IEC 42001:2023 „Tehnologia informației — Inteligență artificială — Sistem de management” a fost publicat în decembrie 2023 de către Organizația Internațională de Standardizare. În iulie 2024, Asociația de Standardizare din România l-a adoptat ca standard român, cu titulatura SR ISO/IEC 42001:2024 „Tehnologia informației — Inteligență artificială — Sistem de management”.

Adoptarea a fost integrală. Cu alte cuvinte, standardul român este identic cu cel internațional. Prin urmare, certificarea obținută în România beneficiază de recunoaștere internațională.

Ce face concret acest standard? El specifică cerințele pentru stabilirea, implementarea, menținerea și îmbunătățirea continuă a unui sistem de management al inteligenței artificiale.

Acest sistem este cunoscut în literatura de specialitate prin acronimul AIMS (Artificial Intelligence Management System), iar în practica românească este denumit SMIA. Standardul se adresează oricărei organizații care furnizează sau utilizează produse și servicii bazate pe sisteme AI, indiferent de dimensiunea, sectorul sau natura juridică a acesteia.

Structura standardului urmează logica familiară altor sisteme de management, precum ISO 9001 pentru calitate, ISO/IEC 27001 pentru securitatea informației sau ISO 22301 pentru continuitatea afacerii. Cerințele de bază sunt grupate în clauzele 4–10. Acestea acoperă contextul organizației, leadershipul, planificarea, suportul, operarea, evaluarea performanței și îmbunătățirea.

În plus, Anexa A conține 38 de controale de referință, organizate în nouă domenii. Acestea variază de la politicile AI și alocarea resurselor până la guvernanța datelor, evaluarea impactului asupra persoanelor și societății, utilizarea responsabilă și relațiile cu terții.

Spre deosebire de alte standarde de management, SR ISO/IEC 42001:2024 introduce un element diferențiator pe care îl consider definitoriu: evaluarea impactului sistemului AI. Nu vorbim doar despre gestionarea riscului pentru organizație, așa cum o face ISO/IEC 27001. Vorbim și despre evaluarea impactului asupra persoanelor fizice, asupra grupurilor și asupra societății în ansamblu.

Această schimbare de perspectivă, care glisează de la organizație către cei afectați de deciziile sistemului AI, reprezintă exact puntea care conectează standardul cu filosofia AI Act.

Certificare AI Act – Ce este și de ce nu este o problemă doar pentru companiile de tehnologie

Regulamentul (UE) 2024/1689 a fost adoptat la 13 iunie 2024 și publicat în Jurnalul Oficial la 12 iulie 2024. Acesta constituie primul cadru legal complet din lume care reglementează inteligența artificială printr-o abordare bazată pe risc.

Logica regulamentului este simplă în principiu, dar complexă în detaliu. Sistemele AI sunt clasificate în patru categorii principale:

- Sisteme cu risc inacceptabil – Acestea sunt pur și simplu interzise. În această categorie intră, de exemplu, manipularea subliminală, exploatarea vulnerabilităților unor categorii de persoane, scoringul social generalizat și identificarea biometrică în timp real în spații publice, cu anumite excepții limitate.

- Sisteme cu risc ridicat – Acestea sunt permise, dar rămân supuse unui set substanțial de cerințe tehnice, organizaționale și de documentare. Aici sunt incluse sistemele listate în Anexa III a regulamentului.

- Sisteme cu risc limitat – Acestea sunt supuse unor obligații de transparență. De exemplu, sistemele care generează conținut sintetic trebuie să îl marcheze ca atare, iar sistemele conversaționale trebuie să informeze utilizatorii că interacționează cu o mașină.

- Sisteme cu risc minim – Acestea sunt supuse doar unor coduri voluntare de bune practici.

Pentru a înțelege amploarea categoriei de risc ridicat, prezint câteva exemple concrete. Sunt vizate sistemele folosite în selecția de personal și evaluarea candidaților, precum și cele care decid accesul la servicii publice esențiale sau evaluează riscul de credit. De asemenea, sunt incluse sistemele de aplicare a legii, cele folosite la frontiere, în administrarea justiției, în educație sau în gestiunea azilului. Tot aici intră și anumite sisteme biometrice sau componente de siguranță ale produselor reglementate, precum dispozitivele medicale și mașinile industriale.

De ce nu este aceasta o problemă doar a companiilor de tehnologie? Pentru că regulamentul distinge explicit între furnizorul sistemului AI, adică cel care îl dezvoltă și îl introduce pe piață, și implementatorul, adică cel care îl utilizează efectiv în operațiunile sale. Dacă organizația dumneavoastră folosește un sistem AI cu risc ridicat achiziționat de la un terț, aveți calitatea de implementator. Prin urmare, vă revin obligații proprii, distincte de cele ale furnizorului.

Obligațiile principale ale implementatorului

Printre cele mai importante obligații ale implementatorului se numără:

- Asigurarea unei supravegheri umane competente, realizată de personal cu alfabetizarea necesară în domeniul IA.

- Utilizarea sistemului în strictă conformitate cu instrucțiunile furnizorului.

- Monitorizarea funcționării sistemului și păstrarea jurnalelor de evenimente.

- Raportarea incidentelor grave.

- Realizarea unei evaluări de impact asupra drepturilor fundamentale înainte de punerea în funcțiune, pentru anumite sisteme.

- Informarea lucrătorilor înainte de introducerea sistemului la locul de muncă.

Calendarul aplicării regulamentului

Articolul 113 al regulamentului stabilește că AI Act se aplică, ca regulă generală, începând cu data de 2 august 2026. Totuși, unele dispoziții au intrat deja în vigoare mai devreme.

Etapele aplicării sunt următoarele:

- De la 2 februarie 2025 sunt aplicabile interdicțiile privind practicile interzise și obligațiile de alfabetizare în domeniul IA pentru personalul care operează sisteme AI.

- De la 2 august 2025 se aplică dispozițiile privind modelele de IA de uz general, structura de guvernanță și regimul sancțiunilor.

- De la 2 august 2026 intră în vigoare obligațiile de conformitate pentru sistemele AI cu risc ridicat, vizându-i atât pe furnizori, cât și pe implementatori.

- Până la 2 august 2027 se extinde termenul pentru sistemele AI integrate în produse reglementate, precum dispozitivele medicale, mașinile industriale sau componentele auto.

Pentru fiecare organizație care operează un sistem AI cu risc ridicat, data de 2 august 2026 marchează obligativitatea de a demonstra conformitatea. Aceasta înseamnă obligația de a arăta că a implementat un sistem de gestionare a riscurilor, că asigură guvernanța datelor, că păstrează documentația tehnică cerută, că a instituit supravegherea umană competentă, că monitorizează performanța sistemului, că are proceduri de raportare a incidentelor și că păstrează jurnalele de evenimente pentru perioada legală.

Sancțiunile prevăzute de regulament sunt substanțiale. Pentru încălcarea obligațiilor aplicabile furnizorilor și implementatorilor de sisteme cu risc ridicat, amenzile administrative pot ajunge la 15 milioane de euro sau la 3% din cifra de afaceri globală anuală.

Este important de reținut, însă, că AI Act este o realitate permanentă, nu un simplu termen care expiră. Organizațiile care încep pregătirea acum vor opera în condiții mult mai confortabile. Cele care vor începe mai târziu vor fi nevoite să demonstreze conformitatea prin mijloace tranzitorii până la finalizarea propriului sistem de management.

Miza nu este doar respectarea unui termen-limită. Miza este construirea unui sistem matur, într-un ritm adaptat organizației dumneavoastră.

De ce este SR ISO/IEC 42001:2024 calea rațională pentru organizații

Construiesc și implementez de ani buni sisteme de management pentru organizații care se pregătesc de certificare. Această experiență mi-a format o convingere fermă: certificarea pe SR ISO/IEC 42001:2024 este cea mai eficientă modalitate de a construi guvernanța AI în organizația dumneavoastră.

Acest lucru este valabil indiferent dacă obiectivul imediat este alinierea cu AI Act, diferențierea competitivă, reducerea riscului operațional sau construirea încrederii în relația cu clienții corporativi sofisticați.Standardul nu acoperă automat toate cerințele regulamentului. Iar cine afirmă contrariul vă induce în eroare. Totuși, logica standardului și cea a regulamentului se suprapun într-o proporție semnificativă. Astfel, sistemul rezultat produce o valoare care depășește simpla conformitate.

Unde se întâlnesc standardul și AI Act

Voi fi mai concret:

- Articolul 17 din AI Act cere furnizorilor de sisteme cu risc ridicat un sistem de management al calității. Standardul 42001 este exact un astfel de sistem, adaptat specific pentru inteligența artificială.

- Articolul 9 din AI Act impune un sistem de gestionare a riscurilor pe tot ciclul de viață al AI. Clauza 6.1 din standard, împreună cu controalele din Anexa A, construiesc exact acest mecanism.

- Articolul 10 solicită guvernanța datelor de antrenament, validare și testare. Controalele din domeniul A.7 acoperă această cerință.

- Articolul 14 cere supraveghere umană efectivă, iar controalele din A.9 stabilesc cadrul procedural necesar.

- Articolul 72 impune monitorizarea post-piață, asigurată prin clauza 9.1 din standard și prin înregistrările operaționale asociate.

Pentru organizațiile care acționează ca implementatori, corespondența este, de asemenea, substanțială. Obligațiile privind evaluarea impactului asupra drepturilor fundamentale sau transparența se traduc, în limbajul unui SMIA, în politici, proceduri și înregistrări care se construiesc natural pe parcursul implementării standardului.

Ce nu acoperă standardul în mod explicit

Există, desigur, și o distanță între cele două documente. Anumite cerințe specifice ale AI Act, cum ar fi declarația de conformitate UE, înregistrarea în baza de date a UE sau documentația tehnică conform Anexei IV, nu sunt solicitate explicit de standard. Într-o implementare matură, aceste documente se adaugă peste arhitectura de bază a SMIA. Exact aici intervine metodologia pe care am dezvoltat-o și pe care o aplic în proiectele mele.

Beneficiile unui SMIA matur

Dincolo de conformitate, un SMIA matur produce beneficii care justifică singure investiția:

- O imagine clară. Veți avea un inventar complet al sistemelor AI din organizație. Multe companii descoperă cu surprindere sisteme de care conducerea nu avea cunoștință.

- Decizii informate. Veți ști ce sisteme merită operate, care trebuie modificate și care ar trebui retrase.

- Siguranță reputațională. Se reduce riscul incidentelor generate de comportamente neintenționate ale sistemelor AI.

- Avantaj competitiv. Veți putea oferi dovezi de guvernanță clienților care solicită acest lucru în procesele de achiziție.

- Scalabilitate. Veți putea integra rapid sisteme AI viitoare într-un cadru deja testat, fără a fi nevoie de o reconstrucție totală a proceselor.

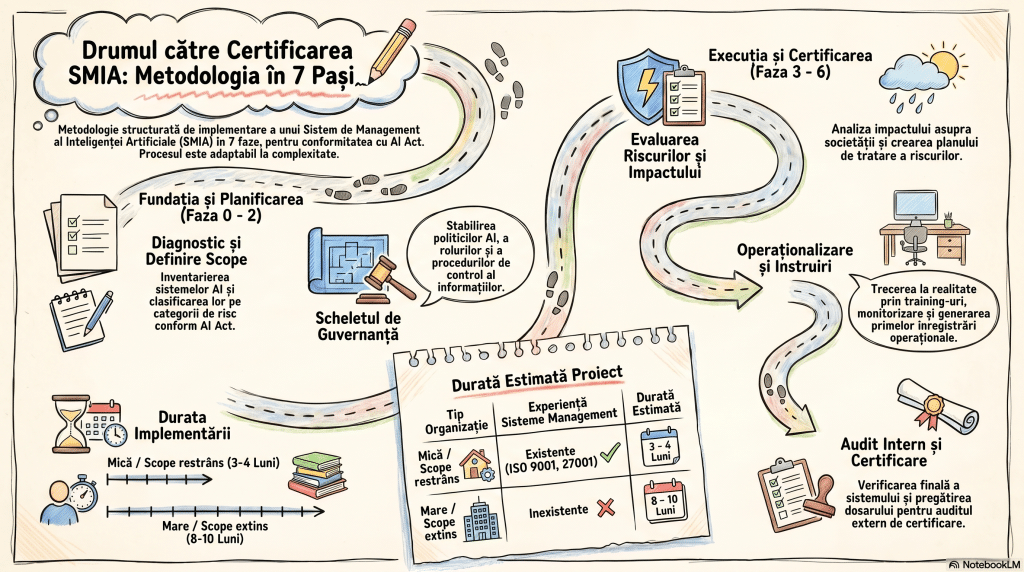

Metodologia mea de implementare – Structură pe șapte faze

Proiectele de implementare care eșuează, și am văzut destule, nu eșuează din lipsa standardului. Standardul vă spune ce trebuie să faceți, iar AI Act vă spune ce sunteți obligați să faceți. Niciunul dintre cele două nu precizează însă ordinea, punctele de plecare, dependențele critice sau modalitățile de a evita blocajele.

Aceasta este funcția metodologiei: transformarea anilor de experiență într-un document operațional utilizabil.

Metodologia pe care o aplic structurează proiectul de implementare în șapte faze consecutive, o fază pregătitoare și șase faze de construcție. Durata proiectului variază în funcție de dimensiunea organizației, complexitatea sistemelor AI operate, numărul de roluri asumate în lanțul valoric AI și existența altor sisteme de management, precum ISO 9001, ISO/IEC 27001 sau ISO 22301, cu care SMIA se poate integra.

Pentru o organizație mică, cu un scope restrâns și cu sisteme de management deja implementate, proiectul se poate finaliza în trei-patru luni. Pentru o organizație mare, cu scope extins și fără alte sisteme anterioare, proiectul poate dura opt-zece luni. Calendarul exact se stabilește la începutul fiecărui proiect, pe baza diagnosticului inițial. Fiecare fază se încheie cu un milestone verificabil și cu livrabile concrete. Trecerea la faza următoare fără milestone-ul celei anterioare este, din experiența mea, cauza principală a derapajelor de buget și de termen.

Structura proiectului, în formă concentrată

Faza 0 — Pregătire și contractare – Se constituie echipa internă, se semnează contractul și acordul de confidențialitate, se calibrează așteptările și se fixează calendarul.

Faza 1 — Diagnosticare și definire scope – Se inventariază toate sistemele AI ale organizației, se clasifică pe roluri și pe categorii de risc conform AI Act, se face analiza diferențelor față de standard și se stabilește formal domeniul de aplicare al SMIA.

Faza 2 — Fundamentele sistemului – Se construiește scheletul de guvernanță: politica AI, rolurile și responsabilitățile, obiectivele AI, procedurile de control al informațiilor documentate și planul de comunicare.

Faza 3 — Riscuri și evaluări de impact – Se elaborează metodologia de evaluare a riscurilor, se face prima evaluare completă a riscurilor, se evaluează impactul fiecărui sistem AI asupra persoanelor și societății și se aprobă planul de tratare a riscurilor.

Faza 4 — Controale operaționale și declarația de aplicabilitate – Aceasta este faza cu cel mai mare volum documentar. Aici se construiește pachetul de documente asociate controalelor din Anexa A, se redactează declarația de aplicabilitate și se finalizează corelarea dintre standard și AI Act.

Faza 5 — Operaționalizare, competențe și înregistrări – Sistemul trece de la hârtie la realitate. Se construiește matricea de competențe, se desfășoară instruirile, se pun în funcțiune jurnalele de evenimente și procedurile de monitorizare și se generează primele înregistrări operaționale.

Faza 6 — Audit intern, analiză de management și pregătire certificare – Se efectuează primul audit intern complet, se tratează constatările, se desfășoară analiza efectuată de management, se redactează manualul SMIA și se pregătește dosarul pentru auditul extern de certificare.

Principiile pe care le consider nenegociabile

Metodologia acoperă un nucleu de aproximativ 60 de documente aplicabile oricărei organizații care dezvoltă, integrează sau utilizează sisteme AI, plus o anexă modulară cu documentele suplimentare cerute de AI Act. Acestea se activează condiționat, în funcție de rolul organizației în lanțul valoric AI și de categoriile de risc ale sistemelor operate.

O organizație care este exclusiv implementator de sisteme cu risc ridicat va construi un pachet mai restrâns decât o organizație care este simultan furnizor și implementator. Metodologia calibrează exact acest pachet.

Dincolo de structura pe faze, metodologia încorporează câteva principii pe care le consider nenegociabile:

- Dubla trasabilitate. Fiecare document din SMIA este trasabil către clauza standardului care îl cere și, acolo unde există, către articolul AI Act pe care îl acoperă. Dubla trasabilitate permite auditorilor să evalueze rapid coerența sistemului și organizației să demonstreze conformitatea atât în auditul de certificare, cât și în fața autorităților de supraveghere a pieței.

- Integrarea cu sistemele de management existente. Dacă organizația are deja ISO 9001, ISO/IEC 27001, ISO 22301 sau alte sisteme, documentația SMIA se construiește astfel încât să se integreze, nu să se suprapună. Procedurile transversale (control al documentelor, audit intern, acțiuni corective, analiză efectuată de management) rămân unice pentru toate sistemele. Politicile tematice rămân distincte, dar se aliniază cu politica-umbrelă a organizației.

- Refuzul explicit al șabloanelor copy-paste. Am văzut proiecte care au eșuat spectaculos la audit fiindcă documentația fusese descărcată de pe internet sau generată de un model de limbaj fără adaptare reală. Politica AI a unei organizații trebuie să reflecte deciziile ei strategice asumate, nu fraze generice. Auditorii cu experiență identifică șabloanele generice din primele minute ale auditului.

- Focalizarea pe evaluarea impactului. Evaluarea impactului sistemului AI asupra persoanelor și societății este elementul diferențiator al standardului 42001 față de alte sisteme de management. Calitatea acestor rapoarte se reflectă direct în credibilitatea SMIA. Scurtarea acestui pas este cea mai scumpă greșeală pe care o poate face o organizație în proiectul ei de implementare

Procesul de certificare

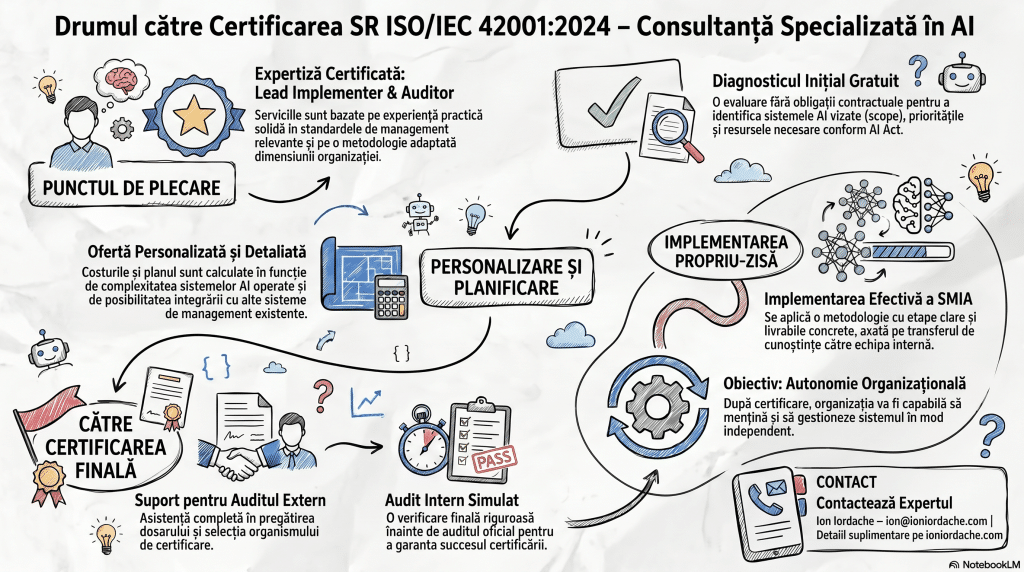

Finalul proiectului de implementare nu este, el însuși, certificarea. Certificarea se obține prin auditul extern, realizat de un organism de certificare independent, acreditat RENAR sau de un alt organism de acreditare internațional recunoscut.

Acest audit este, prin regulă de imparțialitate, complet separat de activitatea consultantului care a condus implementarea. Regulile de certificare impun o separare clară a atribuțiilor: firma care pregătește documentația și cea care o evaluează nu pot fi una și aceeași.

Cele două etape ale auditului extern

- Stage 1 reprezintă o evaluare a documentației și a gradului de pregătire a organizației pentru auditul complet.

- Stage 2 constituie auditul propriu-zis pe teren, care include interviuri, verificarea înregistrărilor și evaluarea implementării efective.

Durata totală a procesului de certificare, de la contractarea organismului până la emiterea certificatului, este stabilită de către organismul de certificare. Aceasta depinde de dimensiunea organizației, de domeniul de aplicare și de disponibilitatea auditorilor.

După finalizarea etapei Stage 2 și remedierea eventualelor neconformități, organismul emite certificatul ISO/IEC 42001. Acesta are o valabilitate de trei ani și necesită audituri de supraveghere anuale.

În calitate de consultant, ofer suport în selecția organismului de certificare, inclusiv criterii de alegere, comparare de oferte și verificarea documentelor de acreditare. De asemenea, ofer suport în transmiterea aplicației. Acest sprijin face parte din faza 6 a metodologiei și nu generează costuri suplimentare pentru organizația client.

Este important de precizat că tariful auditului extern este distinct de costul consultanței și se achită direct organismului de certificare ales.

Cum vă pot ajuta

Ofer consultanță specializată în implementarea standardului SR ISO/IEC 42001:2024, utilizând un model de co-implementare și o structură de proiect adaptată dimensiunii și rolului organizației dumneavoastră în lanțul valoric AI. În calitate de Lead Implementer și Lead Auditor pe standardele de management relevante, și având o experiență practică solidă, vă pot oferi:

Un diagnostic inițial gratuit – Evaluăm împreună poziția organizației față de cerințele standardului și ale AI Act. Identificăm sistemele AI vizate, stabilim prioritățile și calibrăm resursele necesare. Acest diagnostic nu generează obligații contractuale.

O ofertă personalizată și detaliată – Aceasta este calculată în funcție de complexitatea sistemelor AI operate, de existența altor sisteme de management integrabile și de calendarul preferat de conducere.

Implementarea efectivă a SMIA – Aplicăm metodologia descrisă în acest articol, cu etape clare și livrabile concrete. Punem accent pe transferul gradual de competență către echipa internă, astfel încât, după certificare, organizația să poată menține sistemul în mod autonom.

Suport în selecția organismului de certificare – Ofer asistență în pregătirea dosarului de audit extern și realizez un audit intern simulat în faza finală a proiectului.

Pentru o discuție inițială sau o ofertă personalizată, îmi puteți scrie la adresa ion@ioniordache.com sau mă puteți contacta prin intermediul site-ului meu, ioniordache.com, unde veți găsi informații suplimentare despre activitatea mea profesională.

Nu am să vă promit ceea ce nu pot susține. Nu vă garantez obținerea certificării, deoarece decizia finală aparține exclusiv organismului de certificare extern. Vă garantez, în schimb, un proiect condus profesionist, cu o documentație adaptată specificului organizației dumneavoastră, o comunicare directă și respectarea riguroasă a termenelor asumate.

Succesul final depinde de angajamentul conducerii și de disponibilitatea echipei interne.

Inteligența artificială nu este o tendință care poate fi ignorată până când regulile devin stricte. Este o tehnologie pe care merită să o guvernați cu aceeași seriozitate cu care tratați securitatea informației, calitatea sau continuitatea operațiunilor.

Un SMIA matur, certificat conform SR ISO/IEC 42001:2024, este modul prin care demonstrați tuturor părților interesate, angajați, clienți, parteneri sau autorități, că organizația dumneavoastră înțelege și stăpânește această tehnologie. În opinia mea, aceasta este o investiție care produce valoare indiferent de calendarul reglementărilor viitoare.